人工智能應用軟件開發 機遇與風險并存的雙刃劍

近年來,人工智能應用軟件開發蓬勃發展,從智能語音助手到自動駕駛系統,從醫療診斷到金融投資,AI技術正以前所未有的速度滲透到人類生活的各個角落。伴隨著這種技術飛躍,一個嚴肅的問題也隨之浮現:人工智能的崛起是否可能成為人類文明的終結?

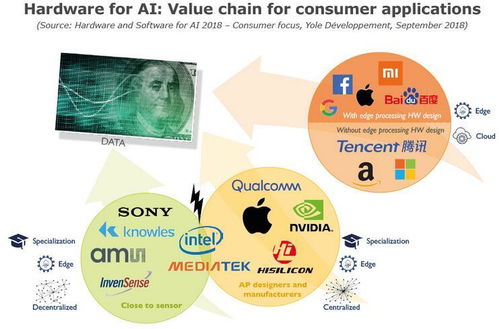

人工智能應用軟件開發的飛速進步確實帶來了前所未有的便利與效率。通過深度學習算法,這些軟件能夠處理海量數據、識別復雜模式,甚至在某些領域超越了人類的能力。企業利用AI應用優化運營,醫生借助AI系統進行精準診斷,教育機構采用個性化學習軟件,這些都極大地提升了生產力與服務質量。

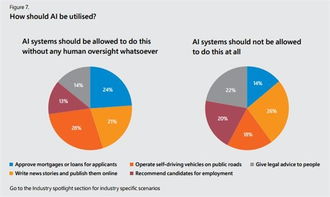

這種技術的快速發展也帶來了潛在風險。隨著AI系統變得越來越自主,控制問題日益凸顯。如果人工智能應用軟件在關鍵領域(如軍事、金融或基礎設施管理)出現不可預測的行為,可能引發災難性后果。大規模失業可能成為社會穩定的威脅,因為AI軟件正逐漸替代傳統工作崗位。更重要的是,如果超級智能AI系統超越人類理解能力,我們可能面臨控制權喪失的終極風險。

但將人工智能的崛起簡單視為人類文明的終結未免過于悲觀。關鍵在于我們如何規范和引導AI應用軟件開發。通過建立完善的倫理框架、安全協議和國際監管體系,我們可以最大限度發揮AI的積極作用,同時規避其潛在危險。開發者應當將安全性和透明度作為核心設計原則,政策制定者需要前瞻性地立法規范,而公眾也應積極參與這場關乎人類未來的討論。

人工智能應用軟件開發正處于十字路口。它既可能成為推動人類文明向前發展的強大引擎,也可能成為潛在的存在性威脅。我們的選擇將決定最終走向——是通過負責任的發展讓AI成為人類的合作伙伴,還是因失控而導致不可預料的后果。在這個技術變革的時代,保持警惕與樂觀的平衡,或許是通往安全未來的最佳路徑。

如若轉載,請注明出處:http://www.plujtyyaa.cn/product/23.html

更新時間:2026-01-08 07:58:25